PORTAL DE ONG: AVANZAMOS EN TRANSFORMACIÓN DIGITAL

04/12/2024

En la sala “Por Talento Digital” de la Fundación ONCE, la Plataforma de ONG ha realizado el 29 de noviembre su jornada 'Innovación e Inteligencia Artificial: oportunidades y riesgos para las entidades del Tercer Sector' dentro de su marco de trabajo del Grupo de Transparencia, Buen Gobierno e innovación.

El objetivo de este encuentro ha sido el de intercambiar conocimiento para conocer las implicaciones que tiene la legislación de Inteligencia Artificial (IA) para las entidades sociales y sus posibles usos fraudulentos, que son críticos para ellas. Sin olvidarse de que el desarrollo y establecimiento de la IA es un tema importante a trabajar porque será esencial en un futuro próximo, al incorporarse en las herramientas digitales de los procesos internos y externos de las entidades sociales que las ayudarán en cuanto a eficacia y eficiencia. Sin embargo, no debe olvidarse de que, aunque la IA es una oportunidad para las entidades sin ánimo de lucro, también abre la puerta a una serie de riesgos para el pleno disfrute de los derechos fundamentales; y por ello la Plataforma de ONG ha querido reunir a personas expertas de instituciones y organizaciones sociales en materia de Transformación Digital, IA, ciberseguridad y Protección de datos, para debatir y profundizar sobre todo ello.

Inició la apertura del acto Virginia Carcedo, secretaria general e Inserta Empleo y directora de Transformación, Excelencia e Igualdad de la Fundación ONCE, quien destacó que “La Inteligencia Artificial es un paradigma que está aquí y, como no podemos ponerle puertas al campo, necesitamos como organizaciones sociales decidir qué IA queremos para la sociedad y para las personas a las que atendemos.” Por eso quiso remarcar que, con esta visión, la IA debe tener el centro en “los datos éticos, sin sesgos, con la que no se deje a nadie atrás, pero también con la que se genere conocimiento y gestione proyectos de forma eficiente."

A sus palabras siguió la presidenta de la Plataforma de ONG de Acción Social, Yolanda Besteiro, quien hizo un discurso en el que destacó la importancia de analizar y anticiparse a los retos, destacando que, ya que la IA ha llegado para quedarse, no se puede permanecer al margen. Por eso, resaltó la importancia de “reflexionar y buscar medidas preventivas a los posibles riesgos que la IA pueda traer a las organizaciones sociales y a las personas que atendemos.” Yolanda Besteiro también quiso dedicar unas palabras de condolencia y apoyo a las víctimas de la DANA y sus familias, así como a toda la comunidad afectada. Sobre ello también quiso hacer hincapié en las campaña de desinformación que se ha generado y sobre la que quiso hacer un llamamiento para poder “abordar esta desinformación desde el conocimiento y la innovación, porque ahora es más urgente que nunca luchar contra ella para acelerar la recuperación de las personas y zonas afectadas tras lo sucedido." Para ello también quiso animar a todas las personas asistentes a la jornada a participar activamente en la sesión, para “dialogar y extraer conclusiones que nos abran el camino a encontrar nuevas formas y proyectos que nos ayuden a responder mejor al reto tecnológico y a las brechas de desigualdad que genera para conseguir nuestra misión de defensa y garantía de los derechos sociales."

|

|

|

A continuación, se dio paso a la primera mesa de la jornada “Inteligencia Artificial y organizaciones sociales” en el que participaron Oscar D. Perea, de la Plataforma de ONG de Acción Social para hablar de los Retos de la Inteligencia Artificial en el Sector Social y de la normativa aplicable; Héctor René Suárez Suárez, líder de Big Data, Ciencia de Datos e Inteligencia Artificial en el Instituto Nacional de Ciberseguridad (INCIBE) para profundizar sobre “Inteligencia Artificial y ciberseguridad. Riesgos de la IA y Herramientas para detectar usos fraudulentos”; y Andrés Calvo Medina, jefe del área de Tecnología en la División de Innovación y Tecnología de la Agencia Española de Protección de datos (AEPD) que habló de “Inteligencia Artificial y Protección de Datos.”

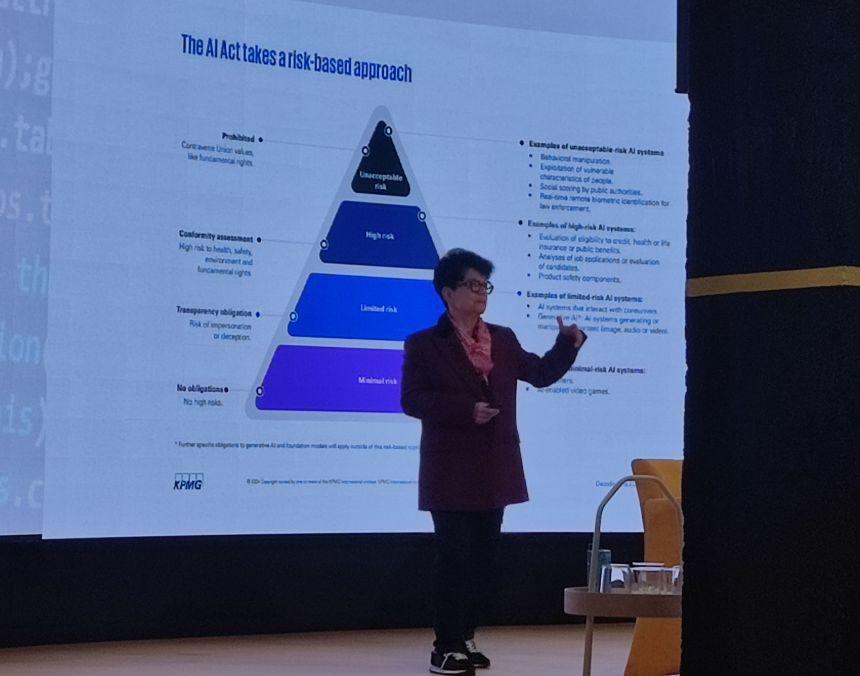

En esta mesa Óscar Perea planteó el marco legislativo de la IA, clasificando al IA por tipo de riesgo, cómo se realiza la evaluación y mitigación de los mismos, la importancia de su cumplimiento y supervisión, de la trasparencia, así como la supervisión humana y revisión y control de datos para el control de los derechos fundamentales, para no perder de vista su protección ni, por tanto, la confianza de las personas vulnerables.

Por su parte Héctor R. Suárez del INCIBE profundizó en los riesgos de la IA, así como en sus desafíos ya que, como destacó, los algoritmos de la IA pueden ser sesgados si los datos que utilizan son incompletos o no representativos; también destacó la preocupación por utilizar la IA para fines malintencionados o por cómo afecte a la privacidad, la seguridad y la responsabilidad.

Entre otras ideas que Héctor R. Suárez quiso transmitir a su público fue qué es la IA y los tres tipos que hay (especial, general y superior), así como el hecho de que la IA se ha usado durante mucho tiempo en sectores como el sistema sanitario, o el financiero, pero que, por estar presente en sistemas tan sensibles, precisamente, debe basarse en un ética y en una IA segura con unos principios de altruismo, humildad y de observación. Sin embargo, de cara a resolver incidentes, también recalcó la importancia de la formación de los equipos en ciberseguridad, y por ello también recomendó a todas las personas asistentes que, ante la duda de si se ha tenido un fallo de ciberseguridad, lo mejor es llamar al 017 para implementar, en el caso de que sea necesario, medidas de ciberdefensa.

Por último, en esta mesa participó Andrés Calvo de la Agencia Española de Protección de Datos quien destacó que, en el entorno digital que vivimos y más de cara a las entidades sociales que trabajan por y para las personas, tal y como recoge la Declaración Universal de los Derechos Humanos: “no protegemos datos, sino personas.” Por ello, indica, el Reglamento de Protección de Datos (RGPD) está pensado para esto, para proteger personas en función del riesgo, ya que, como también dijo, “hay que tener en cuenta la IA nunca viene sola. Viene, entre otras cosas, con biometrías y neuro datos, por lo que puede saber lo que piensan las personas e incluso cambiar su pensamiento influyendo en él.”

Por eso, para estar protegidos dentro del entorno digital, Andrés Calvo dijo que, “para poder proteger correctamente a las personas, la tecnología tiene que ser neutra y, por ello, la IA debe preocuparse por las personas sin sustituir nunca la decisión humana, es decir, sirviendo solo como apoyo para ello.”

|

|

|

Para seguir con la jornada se dio paso a la segunda mesa “Inteligencia artificial: ética y derechos fundamentales” en la que intervinieron Ana Patricia Llaque, Bioethics & Neuroethics Director en OdiseIA para hablar del marco ético y social de la IA; Rafael Merino Rus, responsable de proyectos en la Fundación Fernando Pombo que profundizó sobre la Inteligencia Artificial y los derechos fundamentales, y David Domínguez González, responsable de Transformación Digital y Tercer Sector en la Fundación Esplai Ciudadanía Comprometida que explicó su experiencia con la práctica y aplicación de la Inteligencia Artificial en el Tercer Sector.

En primer lugar, intervino A. Patricia Luque de OdiseIA que destacó sobre todo la importancia de la ética porque, como bien dijo, “ahora mismo hay leyes focalizadas en tecnología, porque debe haber siempre garantías jurídicas que, a su vez, estén relacionadas con valores, porque estos son la bases de los derechos fundamentales y principios éticos.” Sobre esto mismo también quiso resaltar que se debe entender la ética y “preguntarse el cuándo, el para quién, con quién, y cómo de la Inteligencia Artificial, para poder llegar a entenderla y utilizarla correctamente, con ética y valores.”

A su intervención le siguió Rafael Merino de la Fundación Fernando Pombo para hablar de la IA y los derechos fundamentales, para lo cual inició su ponencia destacando de que la IA está amplificando problemáticas sociales como, por ejemplo, la discriminación, ya que, como demostró a través de algunos ejemplos, “puede llegar a generar situaciones de deshumanización e incluso de genocidio.” En base a esto, destacó, que “la Inteligencia Artificial puede ser una poderosa herramienta para fortalecer los DDHH, pero también puede ser la causa de que se vulneren", destacando cinco derechos que se pueden ver vulnerados por ella como son la privacidad, la vigilancia masiva en el espacio público o privado, la libertad de pensamiento, los derechos relacionados con la justicia o el derecho a tener una vida adecuada.

Por todo ello Rafael Merino quiso acabar su intervención planteando las siguientes incógnitas: “teniendo en cuenta que la Inteligencia Artificial ya casi nos controla... ¿Cómo podemos controlarla nosotros? ¿Qué podemos hacer?” A lo que él mismo respondió: “Solo podemos seguir regulándola para que sea inclusiva y justa, garantizando los derechos fundamentales y haciendo un buen uso de ella para poder conseguir un mundo mejor apoyándonos en la IA.”

En último lugar intervino David Domínguez de Fundación Esplai, quien dijo que, como entidades sociales “tenemos que incorporar la tecnología a nuestro trabajo, pero no agarrándonos a ella como tabla de salvación, sino capacitándonos en ella para empoderarnos y así poder buscar el enfoque para lo que necesitamos: ayudar a las personas.”

Bajo su experiencia ayudando a otras entidades sociales a digitalizarse, David Domínguez, compartió el trabajo que realizan desde la Fundación Esplai con ellas, destacando que utilizan una metodología de trabajo que empieza con un análisis inicial para localizar procesos habituales en la entidad que son susceptibles de digitalizarse, tras lo cual intentan digitalizar ese proceso previamente identificado y realizar una matriz de riesgos para ver en qué lugar queda ubicado y, así, empezar a utilizar las tecnologías para iniciar el proceso de digitalización, pero “siempre con autocrítica, formándonos y cualificándonos para adquirir esta competencia digital” concluyó.

|

|

|

Para finalizar esta jornada tan interesante donde se intercambiaron tantas ideas y conocimientos, la directora de la Plataforma de ONG, Maria Luisa Gómez Crespo cerró la jornada haciendo un resumen de los principales mensajes lanzados con las siguientes conclusiones: “hemos tratado los usos que no se deben admitir gracias al INCIBE, quien nos ha facilitado sus recursos como su formación en línea en el teléfono del 017 para llamar en caso de recibir ciberataques algo que, por desgracia, está a la orden del día para muchas entidades sociales” destacó. En esta misma línea resaltó el esfuerzo que había dejado patente la AEPD para proteger a las personas, no solo a los datos, poniendo también a disposición de todas sus últimas novedades en materia de Inteligencia Artificial a través de su web.

Sobre la segunda mesa Marisa Gómez quiso destacar el debate y la necesidad de dotar la IA con garantías jurídicas basadas en nuestro valores que habían destacado desde OidseIA, así como la necesidad de “analizar los riegos que puede tener el desarrollo tecnológico, pues realmente no sabemos quién está detrás y quién está desarrollando el qué” resaltó.

De la intervención de la Fundación Fernando POMBO resaltó el siguiente mensaje: “es necesario abogar por Inteligencia Artificial inclusiva y justa, evitando discriminaciones y sesgos”; así como resaltó la necesidad de formación en la que tanto habían insistido desde Fundación Esplai, de cuya intervención también destacó toda la batería de recursos para poder culminar dicho objetivo.

Por último, quiso terminar su intervención, y con ella la jornada que había tenido lugar, destacando que “debemos aprovechar la tecnología, para democratizar su acceso y construir una sociedad con mejores y mayores oportunidades para todas las personas.”

|

Accede a la galería de fotos de la jornada aquí:

|

Si quieres acceder a toda la jornada tienes la sesión completa grabada aquí: